Kiểm kê tri thức và đánh giá chất lượng

LLA khảo sát bộ sưu tập tài liệu, định dạng, vị trí lưu trữ, mẫu truy cập và vấn đề chất lượng.

Hầu hết tổ chức tích luỹ nhiều năm tri thức vận hành trong tài liệu, email, SOP và file chính sách — phân tán trên shared drive, kho email, thư mục local và hệ thống cũ. Khi nhân viên cần trả lời câu hỏi tuân thủ, tìm tiền lệ hoặc tra chính sách, họ tìm kiếm thủ công, hỏi đồng nghiệp hoặc bỏ cuộc và trả lời bằng trí nhớ. Tri thức tồn tại. Vấn đề là không ai tìm thấy nó một cách đáng tin cậy, và câu trả lời không thể xác minh ngược về nguồn.

Giá trị của hệ thống AI doanh nghiệp không nằm ở model. Nó nằm ở chất lượng, tổ chức và quản trị của cơ sở tri thức mà model sử dụng. LLA xây lớp tri thức trước — pipeline ingest, kiểm soát truy cập, cấu trúc metadata và logic retrieval — rồi mới kết nối model. Điều này tạo ra câu trả lời có thể trích dẫn, xác minh và kiểm toán. Nó cũng có nghĩa hệ thống cải thiện khi cơ sở tri thức cải thiện, không phải khi model thay đổi.

LLA khảo sát bộ sưu tập tài liệu, định dạng, vị trí lưu trữ, mẫu truy cập và vấn đề chất lượng.

LLA thiết kế pipeline ingest: định dạng tài liệu, yêu cầu OCR, quy tắc trích xuất metadata, chiến lược chunking và chọn model embedding.

Qdrant hoặc vector store tương đương được cấu hình. Logic retrieval, tham số hybrid search và xếp hạng kết quả được tinh chỉnh với tài liệu thực.

Quyền truy cập tài liệu theo vai trò được ép ở lớp retrieval. Điều phối trợ lý AI kết nối truy vấn với đúng domain tri thức.

Mọi truy vấn, kết quả retrieval và câu trả lời AI được ghi log. Giám sát chất lượng phát hiện khoảng trống. Cơ sở tri thức được cập nhật theo chu kỳ.

Phân quyền theo vai trò, nhật ký kiểm toán, kiểm tra hợp lệ dữ liệu, kiểm soát tệp an toàn, quy trình phê duyệt và cấu hình theo môi trường.

Triển khai private cloud, VPS, Docker/Coolify, IIS hoặc mô hình hybrid tùy theo yêu cầu bảo mật và hạ tầng của khách hàng.

LLA định vị AI Hub như một lớp tri thức có kiểm soát: truy xuất được nguồn, lọc đúng quyền, vận hành được trên hạ tầng doanh nghiệp, và đủ nhật ký để giải trình khi cần.

AI không chỉ trả lời. Mỗi kết quả phải gắn với tài liệu, đoạn trích và ngữ cảnh đủ để người dùng kiểm chứng trước khi dùng vào quyết định nghiệp vụ, tuân thủ hoặc pháp lý.

Người dùng chỉ nhận được câu trả lời được sinh ra từ tài liệu họ thực sự có quyền xem. Đây là khác biệt giữa một chatbot nội bộ và một nền tảng AI có quản trị truy cập rõ ràng.

LLA hỗ trợ kiến trúc private deployment với vector store, model routing và audit log nằm trong môi trường do khách hàng kiểm soát, không ép buộc phụ thuộc API công cộng hoặc public SaaS.

Khối triển khai này bám theo content model của AI Hub: vector store chuyên dụng, model routing linh hoạt, kho tài liệu riêng, và độ trễ retrieval/response đủ cho các tác vụ nghiệp vụ hằng ngày.

Khối này lấy trực tiếp từ governance profile của AI Hub: truy vấn, retrieval event, và câu trả lời đều phải có user identity, timestamp, và source reference trước khi được xem là chấp nhận được trong môi trường doanh nghiệp.

Hầu hết tổ chức tích luỹ nhiều năm tri thức vận hành trong tài liệu, email, SOP và file chính sách — phân tán trên shared drive, kho email, thư mục local và hệ thống cũ. Khi nhân viên cần trả lời câu hỏi tuân thủ, tìm tiền lệ hoặc tra chính sách, họ tìm kiếm thủ công, hỏi đồng nghiệp hoặc bỏ cuộc và trả lời bằng trí nhớ. Tri thức tồn tại. Vấn đề là không ai tìm thấy nó một cách đáng tin cậy, và câu trả lời không thể xác minh ngược về nguồn.

Trợ lý AI chung thất bại trong môi trường doanh nghiệp vì ba lý do: không truy cập được tài liệu nội bộ, không tôn trọng kiểm soát truy cập và không trích dẫn nguồn câu trả lời. Một AI tạo ra câu trả lời tự tin, không trích dẫn từ cơ sở tri thức không kiểm soát không phải công cụ năng suất — mà là rủi ro tuân thủ. AI doanh nghiệp phải có quản trị: truy cập có kiểm soát, câu trả lời có thể truy vết và audit hồ sơ cho mọi truy vấn.

Giá trị của hệ thống AI doanh nghiệp không nằm ở model. Nó nằm ở chất lượng, tổ chức và quản trị của cơ sở tri thức mà model sử dụng. LLA xây lớp tri thức trước — pipeline ingest, kiểm soát truy cập, cấu trúc metadata và logic retrieval — rồi mới kết nối model. Điều này tạo ra câu trả lời có thể trích dẫn, xác minh và kiểm toán. Nó cũng có nghĩa hệ thống cải thiện khi cơ sở tri thức cải thiện, không phải khi model thay đổi.

Thay vì triển khai đại trà ngay từ đầu, AI Hub phù hợp nhất khi bắt đầu từ một miền tri thức cụ thể, có tài liệu, có quy trình, và có nhu cầu kiểm chứng rõ ràng.

Tra cứu quy định, tiền lệ nội bộ, điều khoản hợp đồng và văn bản pháp lý với yêu cầu bắt buộc về nguồn trích dẫn và truy vết truy vấn.

Rà soát chính sách, kiểm soát bằng chứng tuân thủ, chuẩn hóa câu trả lời nội bộ và giảm phụ thuộc vào việc hỏi thủ công giữa các bộ phận.

Khai thác kho FAQ, playbook, lịch sử xử lý và tài liệu sản phẩm để trả lời nhanh hơn nhưng vẫn bám đúng tài liệu chính thức.

Áp dụng cho các đơn vị có nhiều SOP, checklist và hướng dẫn nội bộ, nơi nhân sự cần tìm đúng phiên bản tài liệu đúng vai trò trong thời gian ngắn.

Doanh nghiệp có kho tài liệu nội bộ, tài liệu pháp lý, SOP, chính sách, email archive, kiến thức hỗ trợ và sổ tay vận hành.

Dịch vụ ASP.NET Core mô-đun, bản ghi vận hành trên PostgreSQL, kiểm soát truy cập theo vai trò, tích hợp ưu tiên API và quy trình sẵn sàng kiểm toán.

Mỗi năng lực được thiết kế xung quanh một vấn đề vận hành cụ thể, không phải danh sách tính năng chung chung.

Tri thức nội bộ bị khoá trong PDF, Word, file scan, email và định dạng cũ mà AI không đọc trực tiếp được.

Pipeline ingest xử lý PDF, DOCX, XLSX, email, ảnh (OCR) và dữ liệu có cấu trúc. Tài liệu được xử lý, chunking và index tự động.

Tìm kiếm từ khoá không tìm thấy tài liệu liên quan về khái niệm. Người dùng bỏ lỡ tri thức liên quan vì không biết thuật ngữ chính xác.

Retrieval hybrid kết hợp tìm kiếm tương đồng vector với duyệt đồ thị tri thức — tìm nội dung liên quan về khái niệm ngay cả khi thuật ngữ không khớp.

AI chatbot chung nhận câu hỏi từ mọi domain và trả lời từ pool tri thức không kiểm soát, không phân quyền.

Điều phối AI hướng mỗi truy vấn đến đúng domain tri thức — pháp lý, vận hành, tuân thủ, sản phẩm — với retrieval và logic phản hồi riêng.

Câu trả lời AI không thể trích dẫn, xác minh hay thách thức vì tài liệu nguồn không được tham chiếu.

Mọi câu trả lời AI kèm tham chiếu tài liệu nguồn, đoạn cụ thể được sử dụng và chỉ báo độ tin cậy. Câu trả lời có thể xác minh ngược về nguồn gốc.

Tất cả người dùng truy vấn tất cả tài liệu qua một trợ lý AI chung. Tri thức bảo mật bị lộ cho vai trò không cần truy cập.

Quyền truy cập tài liệu được ép ở lớp retrieval. Người dùng chỉ nhận câu trả lời từ tài liệu trong phạm vi quyền.

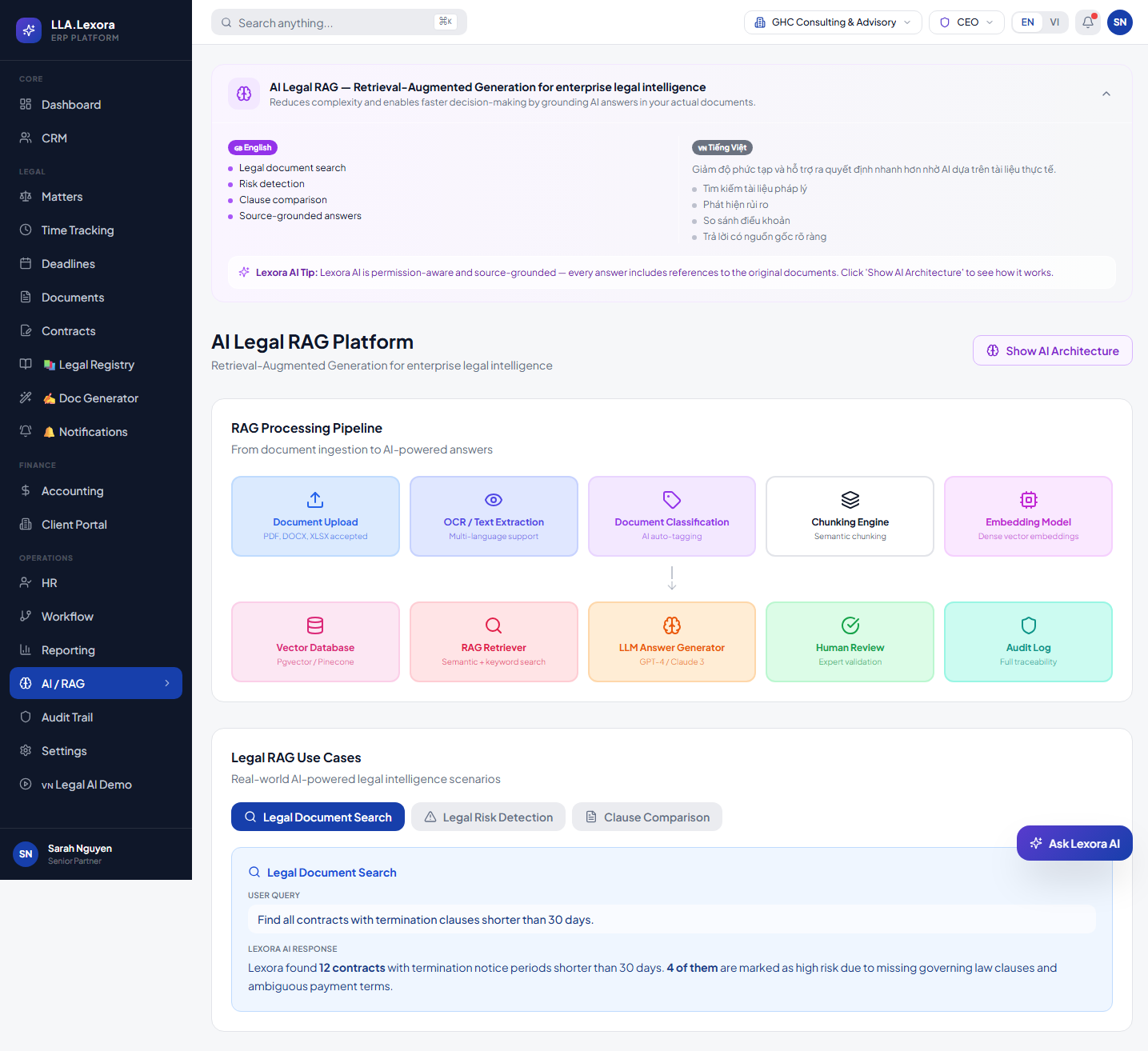

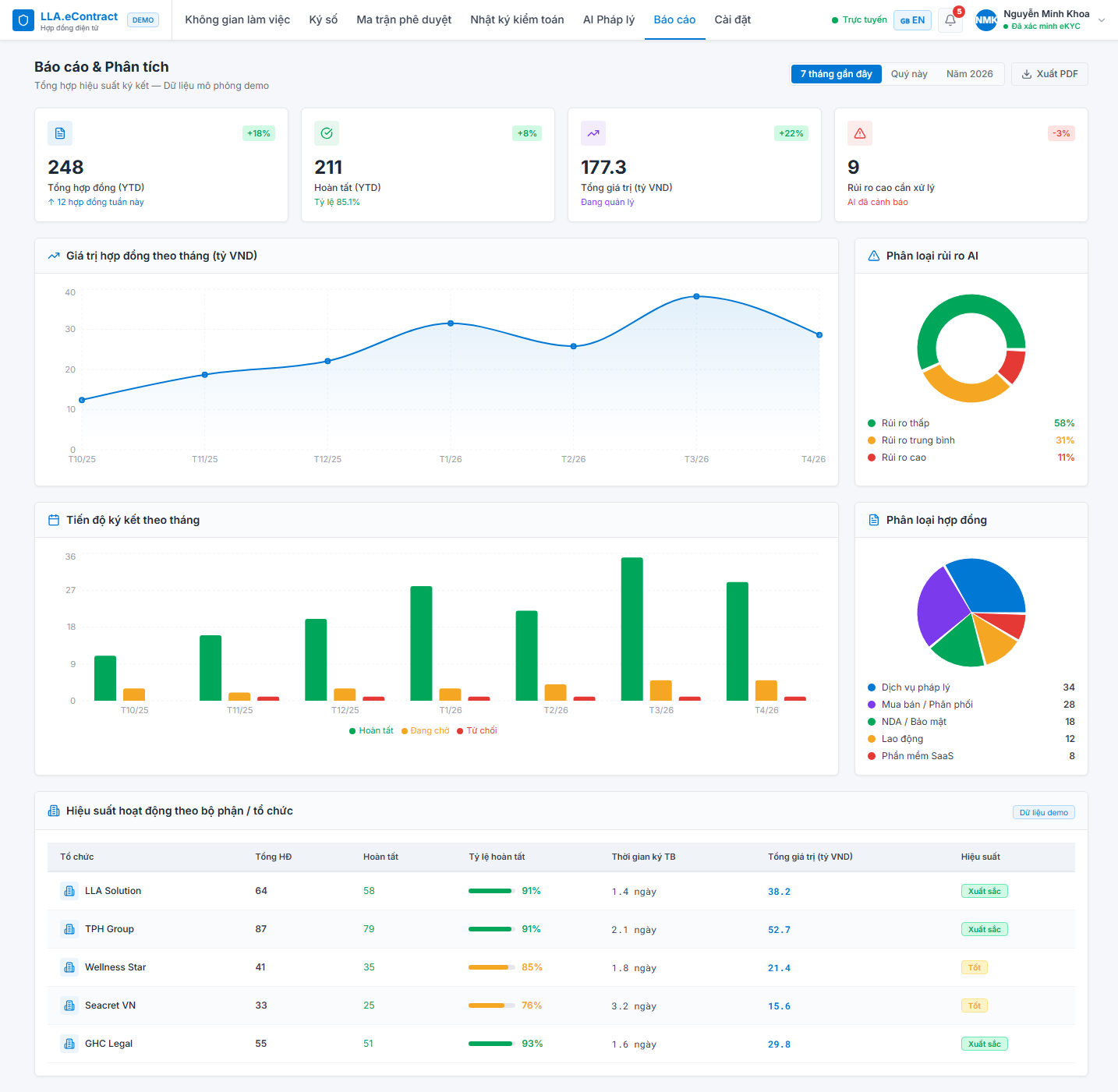

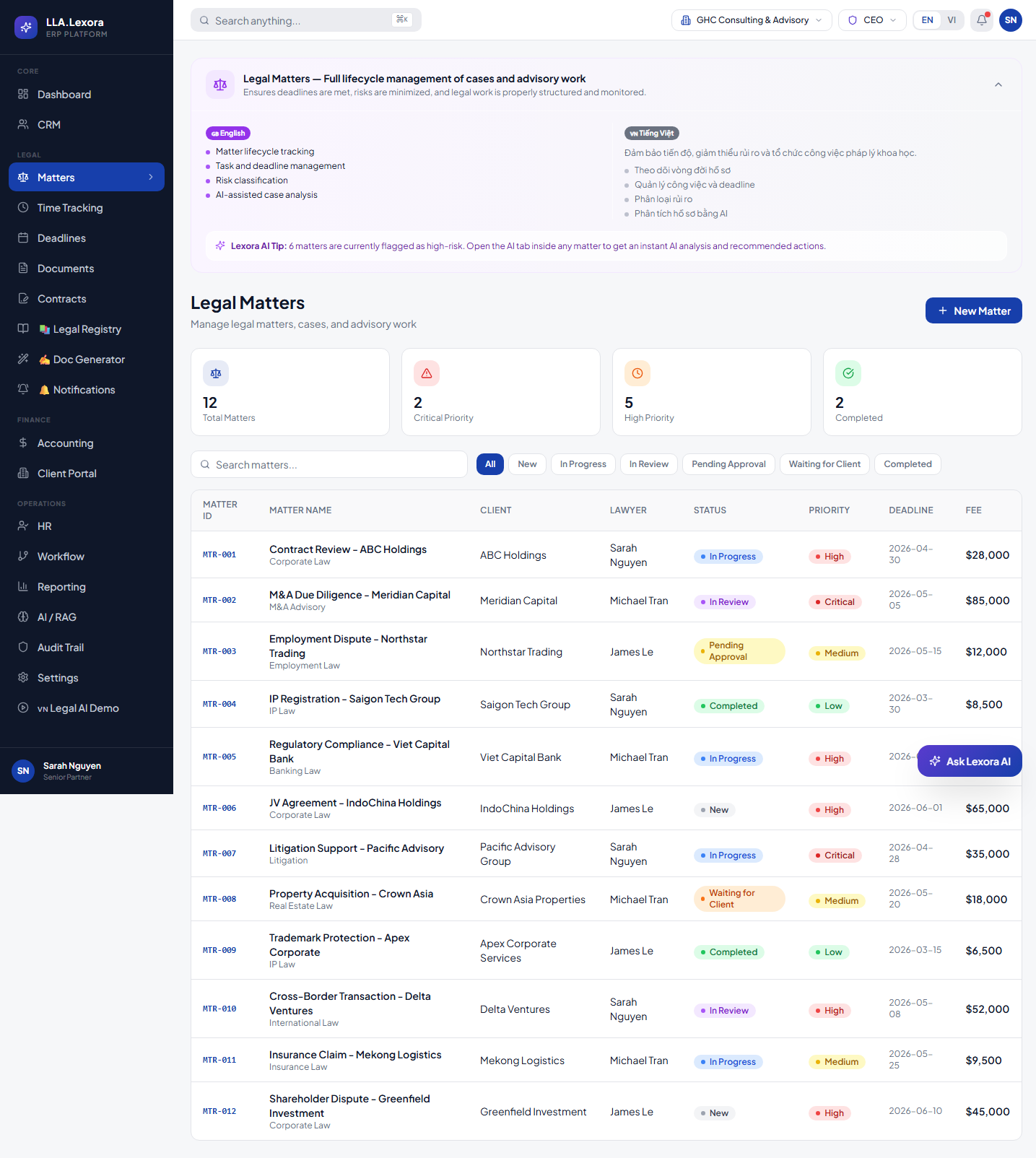

Các bảng showcase được xây dựng từ màn hình vận hành, luồng công việc, dữ liệu demo và bằng chứng kiểm soát.

Các ảnh chụp màn hình này được sử dụng làm bằng chứng sản phẩm: các module thực tế, dữ liệu thực tế, trạng thái quy trình làm việc hiển thị rõ ràng.

Luồng tri thức AI cụ thể: tải tài liệu, trích xuất, phân loại, chia đoạn, embeddings, vector database, truy xuất, trả lời LLM, rà soát người dùng và truy vết kiểm toán.

Mẫu kiểm tra rủi ro AI cho tài liệu pháp lý với điều khoản bị đánh cờ, điểm rủi ro và quy trình rà soát.

Phân loại vụ việc có hỗ trợ AI dựa trên dữ liệu vận hành pháp lý, hạn chót, trạng thái và mức độ rủi ro.

Nền tảng được thiết kế để kết nối với hệ sinh thái LLA và các hệ thống bên thứ ba.

Ingest corpus pháp lý cho nghiên cứu vụ việc, trí tuệ quy định và phân tích hợp đồng.

Tri thức SOP và chính sách vận hành gắn với phê duyệt workflow và hệ thống đào tạo.

Phân tích rủi ro điều khoản AI trên tài liệu trong workflow xem xét hợp đồng.

Cơ sở dữ liệu vector chính cho lưu trữ embedding và retrieval ngữ nghĩa.

Điều phối model AI linh hoạt — model cloud hoặc triển khai local theo yêu cầu chủ quyền dữ liệu.

Mỗi giai đoạn có mốc bàn giao rõ, trách nhiệm rõ và điểm kiểm soát rõ để đội vận hành theo dõi tiến độ theo tuần.

Kiểm kê tài liệu hoàn thành. Đánh giá định dạng, chất lượng và yêu cầu kiểm soát truy cập.

Mốc bàn giaoPipeline ingest, OCR, chunking và embedding hoạt động. Corpus đầu tiên được index.

Mốc bàn giaoVector store được tinh chỉnh, hybrid retrieval cấu hình, kết nối điều phối trợ lý AI.

Mốc bàn giaoKiểm soát truy cập được ép, audit logging hoạt động, giám sát chất lượng cấu hình. Go-live.

Mốc bàn giaoMỗi bộ phận nhận được kết quả cụ thể - không phải lợi ích mơ hồ.

LLA AI Knowledge Hub ép kiểm soát truy cập ở lớp ingest, retrieval và phản hồi. Người dùng chỉ nhận câu trả lời AI từ tài liệu được phép truy cập. Mọi truy vấn, sự kiện retrieval và phản hồi AI được ghi trong audit log với danh tính, timestamp và tham chiếu tài liệu nguồn. Câu trả lời AI không thể hiển thị mà không trích dẫn nguồn. Có thể triển khai hoàn toàn trên hạ tầng khách hàng với model AI local.

LLA xây lớp tri thức trước — ingest, cấu trúc và kiểm soát truy cập — trước khi kết nối model AI.

LLA AI Hub ép kiểm soát truy cập ở lớp retrieval. Người dùng không thể truy cập tài liệu ngoài phạm vi quyền qua truy vấn AI.

Mọi câu trả lời AI trích dẫn nguồn và kiểm toán được — thiết kế cho môi trường theo quy định nơi quyết định AI phải xác minh được.

LLA hỗ trợ triển khai riêng hoàn toàn với model AI local — không phụ thuộc API bên ngoài bắt buộc.

LLA đã xây hệ thống tri thức AI cho domain pháp lý, tuân thủ và vận hành — không phải chatbot chung.

Có. LLA dùng nền tảng sản phẩm làm điểm khởi đầu rồi điều chỉnh quy trình, trường dữ liệu, vai trò, tích hợp và báo cáo theo mô hình vận hành của khách hàng.

Có. LLA hỗ trợ triển khai private bằng Docker/Coolify, IIS, PostgreSQL, object storage và hạ tầng do khách hàng kiểm soát khi cần.

Kiến trúc hỗ trợ nội dung tiếng Việt và tiếng Anh, bao gồm slug đã dịch cho các trang chi tiết công khai.

Với AI Hub, bước đúng đầu tiên không phải demo. Đó là rà soát tài liệu, quyền truy cập, domain tri thức và kiến trúc triển khai để biết hệ thống nên được xây ở mức nào.